Situación jurídica del uso de las IA generativas

Como docentes y profesionales de la educación, tenemos muchas dudas legales al usar ChatGPT y otras inteligencias artificiales (IA) generativas, que, por otro lado, ya son utilizadas ampliamente por los estudiantes y muchos profesionales.

El uso de ChatGPT y otras IA generativas no está recomendado por parte de las autoridades europeas, españolas y catalanas de protección de datos hasta que no se aclare el contexto jurídico de estas tecnologías. Los principales problemas hacen referencia a la protección de datos, a la propiedad intelectual y a la confidencialidad.

Respecto a la protección de datos

Los datos de nuestras conversaciones, que pueden ser confidenciales, sirven para alimentar el sistema. A pesar de que ahora ChatGPT ofrece la posibilidad de marcar que no queremos que las utilice, no queda claro ni cómo lo hace ni si realmente lo hace.

Hasta que el Comité Europeo de Protección de Datos no se pronuncie, la Autoridad Catalana de Protección de Datos ha recomendado no utilizar esta herramienta en el ámbito público (y universitario) cuando se traten datos personales.

Respecto a la propiedad intelectual

En Europa se prevé la posibilidad de usar material digital existente para la minería de datos. Sin embargo, no está claro que el material utilizado para entrenar a ChatGPT se haya recopilado de forma lícita. Además, los propietarios deberían haber tenido la posibilidad de oponerse a que su contenido formara parte de este entrenamiento.

Todavía existen muchas incógnitas sobre si el contenido que ha entrenado a la IA puede estar o no protegido por las leyes en materia de propiedad intelectual o si puede infringir estos derechos, dado que toma como referencia datos e información ajena sin autorización del autor y sin citar las fuentes. Lo que obtenemos de ChatGPT podría infringir derechos de autor.

Respecto a la confidencialidad

Como ChatGPT no da garantías de seguridad de la información guardada, y dado que las funcionalidades que permiten que la herramienta no utilice estos datos tampoco garantizan que esta información no llega a terceros, es desaconsejable incluir cualquier tipo de documentación estratégica, confidencial o que tenga carácter restringido para la organización.

Por lo tanto, en la práctica

Como la recomendación de no utilizarlo es difícil de seguir porque ya se usa de forma generalizada, es necesario dar una serie de pautas. Teniendo en cuenta lo que hemos dicho anteriormente, en caso de que utilicemos ChatGPT, deberíamos tomar estas precauciones:

- Antes de introducir cualquier tipo de contenido (enunciados de preguntas o respuestas de estudiantes), hay que analizarlo para corroborar que no infringe ningún derecho en materia de propiedad intelectual, de protección de datos o de confidencialidad.

- No deberíamos incluir al contenido que se comparta ningún dato de carácter personal o información que pueda hacer identificable a una persona, ningún contenido sobre el que no se ostenten suficientes derechos para utilizarlo, ni ninguna información reservada, confidencial o de carácter estratégico para la universidad.

- Es necesario informar correctamente a los interesados del uso de este contenido, y, si es necesario, obtener su consentimiento expreso, su autorización o las licencias necesarias.

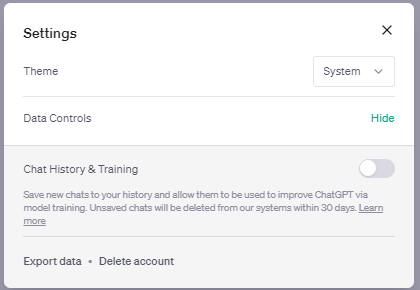

- Aunque no podemos saber con certeza cómo se usará el contenido que publiquemos en ChatGPT, lo más recomendable es seleccionar la opción de oponerse a que este contenido sea utilizado para mejorar el sistema (opt-out) y también utilizar la opción de no guardar las conversaciones (es decir, que nuestra consulta no se utilice para entrenar a la IA).

- Podría ser conveniente plantearse la necesidad real de compartir las respuestas de los estudiantes y valorar si en determinados casos, en lugar de esto, habría la posibilidad de usar respuestas ficticias.

En cuanto a introducir ChatGPT u otras IA generativas en las actividades (ya sea involucrando a los estudiantes en la crítica y la mejora de las respuestas de la herramienta, utilizándola para la ludificación o a partir de otras posibles metodologías o estrategias), sería recomendable analizar los posibles riesgos antes de hacerlo.